拾月周刊(第11期):人类唯一的出路,变成人工智能

这是拾月周刊第11期,共8篇文章,2集播客、2个工具和1条言论。

8篇文章均是ChatGPT和人工智能主题,其中5篇是Tim Urban的《人类唯一的出路》系列。

文章

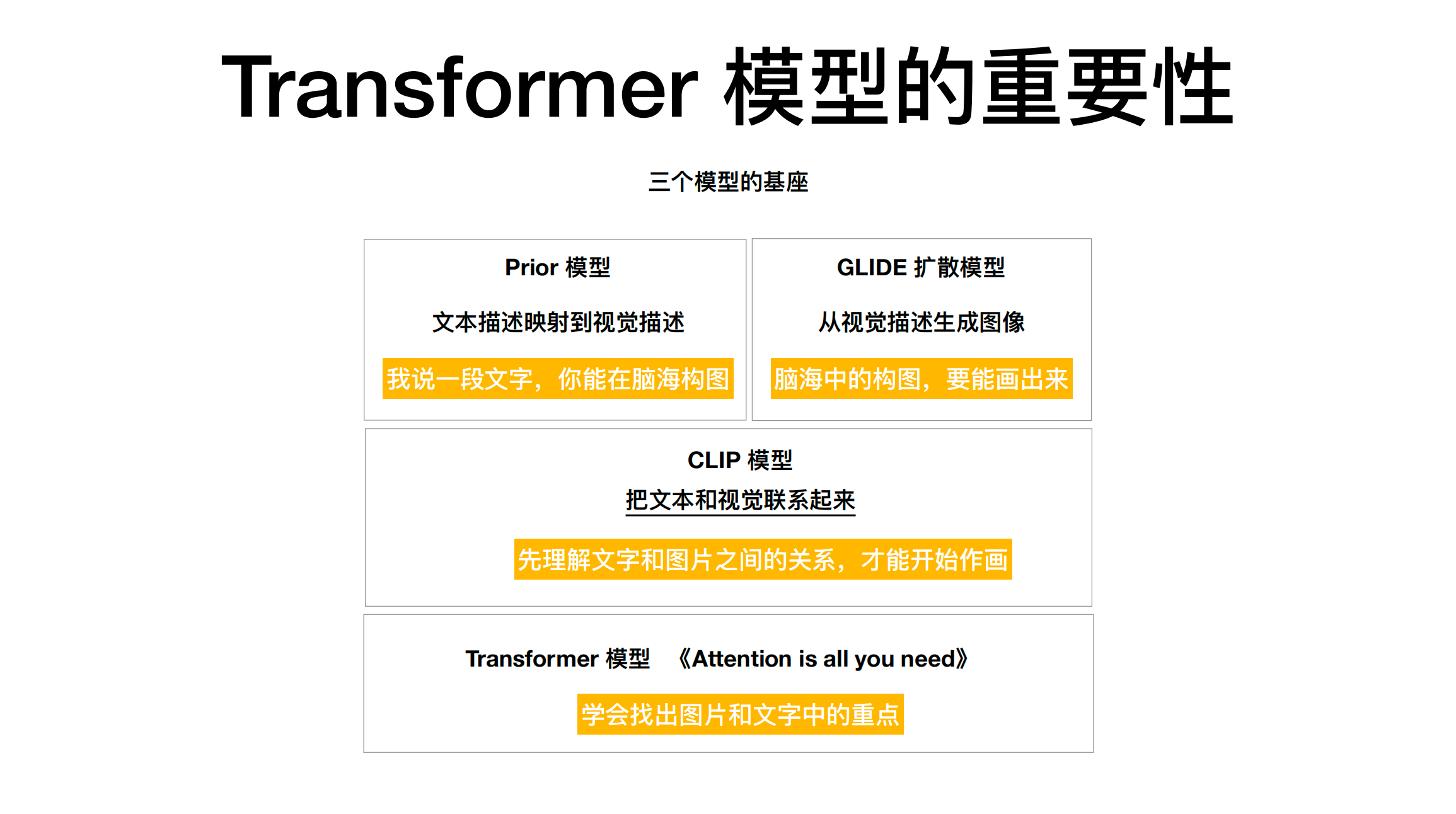

1、ChatGPT 在做什么… 以及它为何发挥作用?

source: mp.weixin.qq.com

非常硬核的技术文章,断断续续读完的。除了技术部分,文中有些非常深刻的观点思考。

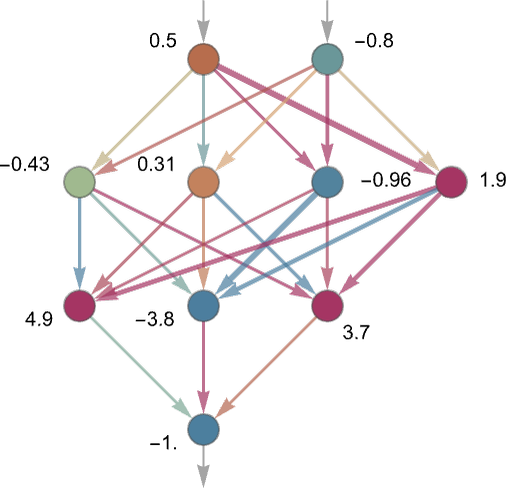

- 神经网络的结构非常简单,但却不可思议的涌现出人类思维,为什么?

- 语言的根本法则是什么,会不会很简单?

- 这个领域,工程走在了理论的前面。

- ……

对于这篇,我专门写了一篇笔记:读《ChatGPT在做什么……以及它为何发挥作用》

2、关于大语言模型的理解的问题在哪里

展开讲讲一些关于大语言模型的理解的问题在哪里

接着前面一条微博,对 AI 的思维链条 CoT 能力和进展多说两句

source: weibo.com

LLM模型从结构设计讲,只是概率输出。但为什么输出的结果却给人以懂逻辑的感觉。这个问题现在仍在研究中,没有结论。木遥这两篇微博介绍了相关概念、背景和研究进展。

3、人类唯一的出路:变成人工智能

人类唯一的出路:变成人工智能 | 初篇

人类唯一的出路:变成人工智能 | 第二篇

人类唯一的出路:变成人工智能 | 第三篇

人类唯一的出路:变成人工智能 | 第四篇

人类唯一的出路:变成人工智能 | 大融合

source: mp.weixin.qq.com

这是Tim Urban写的系列文章,缘起于马斯克创办Neuralink脑机接口公司。

第五篇提到马斯克的基本观点:超人工智能的出现是必然的事情,其中存在两个风险,一是超人工智能直接统治地球,二是超人工智能被少数人控制。

对第一个风险,马斯克认为人类如果不想沦为「其它物种」的一员,唯一的出路是与超人工智能融合,而脑机接口是实现融合的唯一路径。人脑有负责直觉的系统1和负责理性的系统2,超人工智能将成为系统3融合进大脑。

对第二个风险,要让AI民主化,所以他创建OpenAI(开发ChatGPT的公司),开源AI技术。不过,OpenAI已经背离了初衷。

我非常喜欢第一篇给出的宏观视角,介绍了人类大脑和文明的进化,并提出「人类巨灵」和「计算机巨灵」两个关键概念。人类巨灵是把人类作为整体人格化,计算机巨灵则是把计算机作为整体人格化,它们都有着巨大的能量。尽管人和计算机作为个体,十分渺小。

第四篇是非常有想象力的一篇,脑机接口实现之后,人和人的大脑将基于神经元的电信号直接交流,不需要任何媒介,连说话都不需要。地球70亿人的大脑直接连接在一起,是什么样的景象?

第二、三篇则非常的技术细节。

播客

1、50 刘嘉:AI全面超越人类大概率是确定的事|清华大课间004 - 人文清华播客:对话清华学者

source: www.xiaoyuzhoufm.com

- 当前人类所处阶段和工业革命时期类似。

- AI有三个无限:算力无限、存储无限、生命无限。所以,它必将超越人类。

- 无论你从事什么工作,赶紧把ChatGPT用起来。

2、Solo | 迟到的年终盘点,短视频吞噬一切 - 老talk消息

source: www.xiaoyuzhoufm.com

从马斯克收购Twitter(后的各种动作)、马化腾内部信、刘强东回归切入。讲大佬们的战略焦虑。背后最大的原因:短视频在入侵各种业务,即包括社交、电商这些的大平台业务,也包括非常垂直的卖车、招聘等。

在短视频社交方面,前不久从朋友那里了解到一个现象,也在这期播客中得到印证:一些四五线小县城,大家把短视频当朋友圈发,说些家长里短的内容,熟人圈子的八卦也来自短视频。——从来不用短视频的我,听到是有些惊讶的。

播客中提到,这些地方用户的双向关注密度非常高。

工具

一个Chrome插件,可以将Chrome伪装成Edge使用new Bing,不想切换浏览器的可以试试,挺好用。

一个批量删除微博的油猴脚本,完全模拟一次次点击实现的,所以速度不是很快,但胜在方便。我用它清空了1000多条微博。

言论

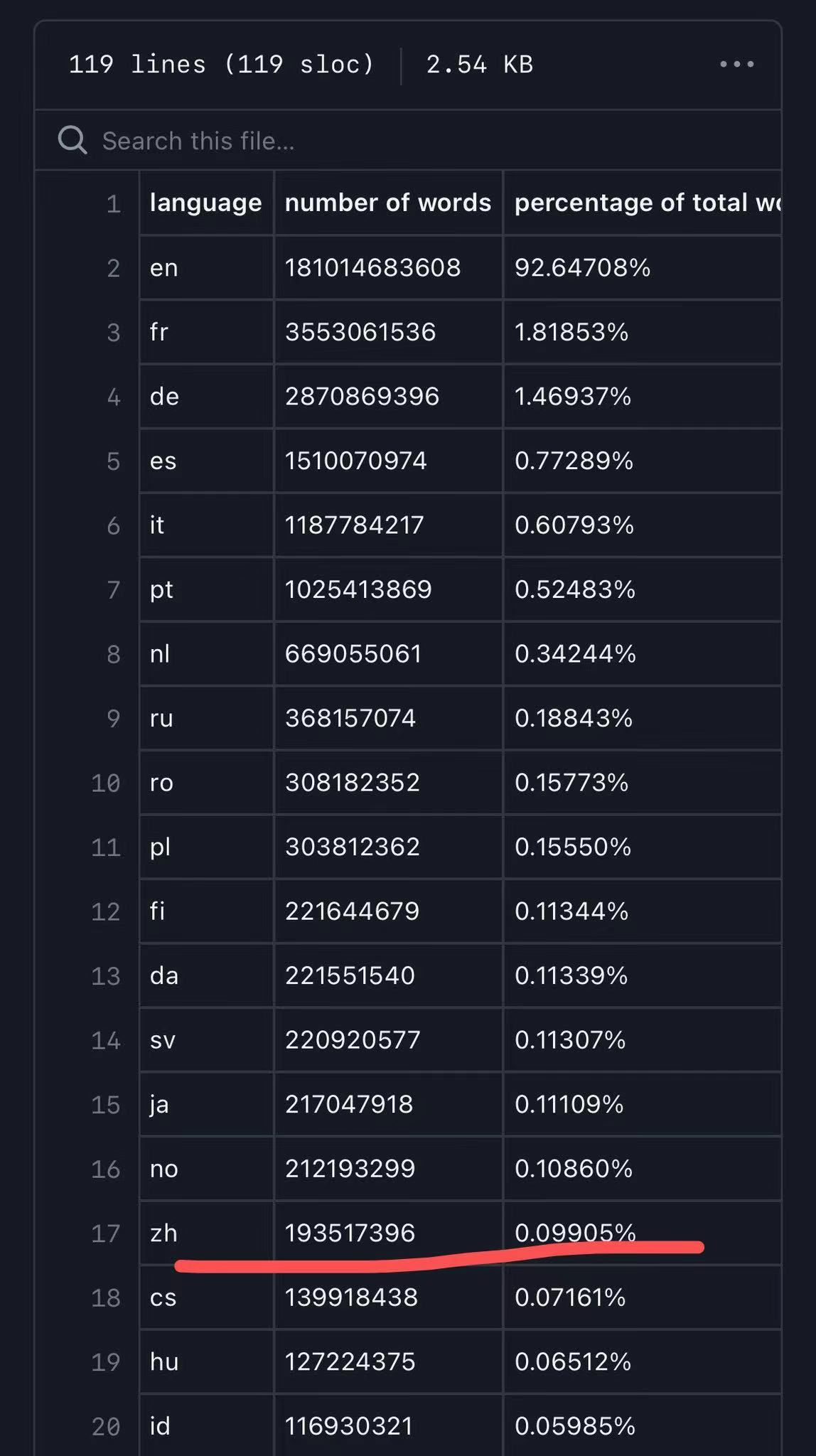

1、关于Mastodon的观察

小小统计了一下,我在Mastodon关注了34个人,其中16人是去年年底(11-12月)马斯克收购Twitter一系列骚操作后加入的,目前仍然活跃的有12个,即两三个月过去了,留存75%,完全超出我的意料呀。——样本太小,但多少能反映出 Mastodon生命力不弱。

留存的用户中, Twitter粉丝最多的是huoju,其次是Andy Matuschak。

流失的用户中, Twitter粉丝最多的是Paul Graham,其次是Michael Nielsen(他是2017年注册的,但2022年底尝试使用)。

当然,留存用户中,有些是Twitter和 Mastodon两边活跃,Mastodon也未完全替代 Twitter。